Generative KI und parlamentarische TA – zwischen Potenzialen, Praxis und Reflexion

Johanna Mehler, Steffen Albrecht, Julia Hahn, Christoph Kehl, Pauline Riousset, Bernd Stegmann, Christine Milchram | 12. März 2026

Verheißungen rund um KI – und die daran anknüpfenden Erwartungen – sind vor allem in der Wirtschaft weit verbreitet. Doch auch in der Wissenschaft wird KI eine bedeutende Rolle zugeschrieben. So verlieh die Königlich-Schwedische Akademie der Wissenschaften 2024 gleich zwei Nobelpreise (für Physik und Chemie) für die Entwicklung und Anwendung von Verfahren maschinellen Lernens. Auch in Deutschland widmen Forschungsorganisationen ebenso wie wissenschaftliche Akademien den Potenzialen von KI für die Wissenschaft eigene Initiativen bzw. Veranstaltungen. Und schon kurz nach Erscheinen von ChatGPT Ende 2022 wurden die Leistungen von generativer KI in der Literaturrecherche, der Verarbeitung von Daten, dem wissenschaftlichen Programmieren und der Wissenschaftskommunikation hervorgehoben (TAB 2023; Fecher et al. 2023).

Demgegenüber steht eine Vielzahl an Risiken, die mit der Nutzung speziell von generativer KI in der Wissenschaft einhergehen. So ist aufgrund des Blackbox-Charakters der KI-Systeme die Entstehung des Outputs häufig nicht transparent und nachvollziehbar und Halluzinationen der KI-Systeme sowie möglicher Bias durch Verzerrungen in den Trainingsdaten stellen weiterhin Probleme dar. Zudem scheinen Sprachmodelle zum starken Generalisieren zu tendieren (Peters und Chin-Yee 2025) und dazu, die Sicht der Nutzenden zu bestätigen, was häufig die Output-Qualität verringert und so zu mehr Halluzinationen trotz größerer Modelle führt (Zhou et al. 2024). Überdies wirft der Einsatz generativer KI Fragen der Verantwortung und Urheberschaft für Forschungsinhalte auf (Mejias 2025). Gleichzeitig zeigen sich weitere Gefahren von „Misuse“, wie die gezielte Verbreitung von Desinformation (Fecher et al. 2025) oder das Austesten unserer kognitiven Grenzen, wenn wir mit Hilfe von LLMs mehr produzieren, dabei aber immer weniger verstehen (Messeri und Crockett 2024). Erste Experimente zeigen, dass generative KI negative Auswirkungen auf kritisches Denken und weitere essenzielle Kompetenzen der Wissensarbeit haben kann (Lee et al. 2025). Nicht zuletzt erfordert die Anwendung von KI in der Wissenschaft häufig die Entwicklung von Software und damit Kompetenzen, die im Wissenschaftssystem nicht ausreichend verbreitet sind (Kapoor & Narayanan 2025).

Während Einigkeit darüber zu herrschen scheint, dass generative KI den wissenschaftlichen Prozess grundlegend verändern wird und sorgfältige Reflexion vonnöten ist, um die wissenschaftliche Integrität und Kompetenz zu bewahren, ist noch offen, wie eine ausgewogene und sichere Integration von KI und menschlichem Fachwissen aussehen kann und sollte. Wir glauben, dass diese Entwicklung proaktiv (mit)gestaltet werden sollte. Wir begrüßen Initiativen wie den Helmholtz AI Hub und die KI-Toolbox des Karlsruher Instituts für Technologie, die einen sicheren Zugriff auf verschiedene lokale und externe LLMs erlaubt. Und wir möchten selbst mit der TAKI-Arbeitsgruppe (siehe Vorstellung im ersten Blogbeitrag dieser Serie) einen Beitrag zur verantwortlichen Nutzung von KI in der Wissenschaft, aber auch der Politikberatung leisten.

Parlamentarische Technikfolgenabschätzung operiert an der Schnittstelle von wissenschaftlicher Analyse und parlamentarischer Politikberatung

Einrichtungen wie das TAB erfüllen wissenschaftliche Qualitätsstandards, verfügen aber über spezialisierte Untersuchungsformate und Prozesse, die auf die Politikberatung ausgerichtet sind und aus welchen sich eigene Anwendungsfälle generativer KI ergeben. Wir sind im Vergleich zur Wissenschaft stärker auf Wissenschaftskommunikation ausgerichtet und müssen Kriterien der politischen Relevanz und Legitimität berücksichtigen (Jahnel et al. 2025). Als Potenzial großer Sprachmodelle wurde beschrieben, dass diese wissenschaftliche Politikberatung agiler und zielgerichteter machen können (Tyler et al. 2023). Doch für welche Arbeitsschritte eignet sich eine Unterstützung konkret? Um dies herauszufinden, testen wir in der TAKI-Arbeitsgruppe anhand konkreter Anwendungsfälle, wie generative KI in Arbeitsbereichen, die wir für die parlamentarische Politikberatung als besonders relevant erachten, zum Einsatz kommen kann und sollte.

Wir testen in diesen Bereichen verschiedene Tools für spezifische Aufgaben, arbeiten durch geteilte Prompts an der Etablierung von Standardnutzungen und vergleichen dabei die Performance von lokalen und cloudbasierten Modellen. Generative KI kann potenziell auch für Bildgenerierung (Jahnel et al. 2025), Weiterbildung sowie Projekt- und Prozessmanagement eingesetzt werden (De Longueville et al. 2025). Im Folgenden geben wir Einblick in zwei unserer Anwendungsfälle.

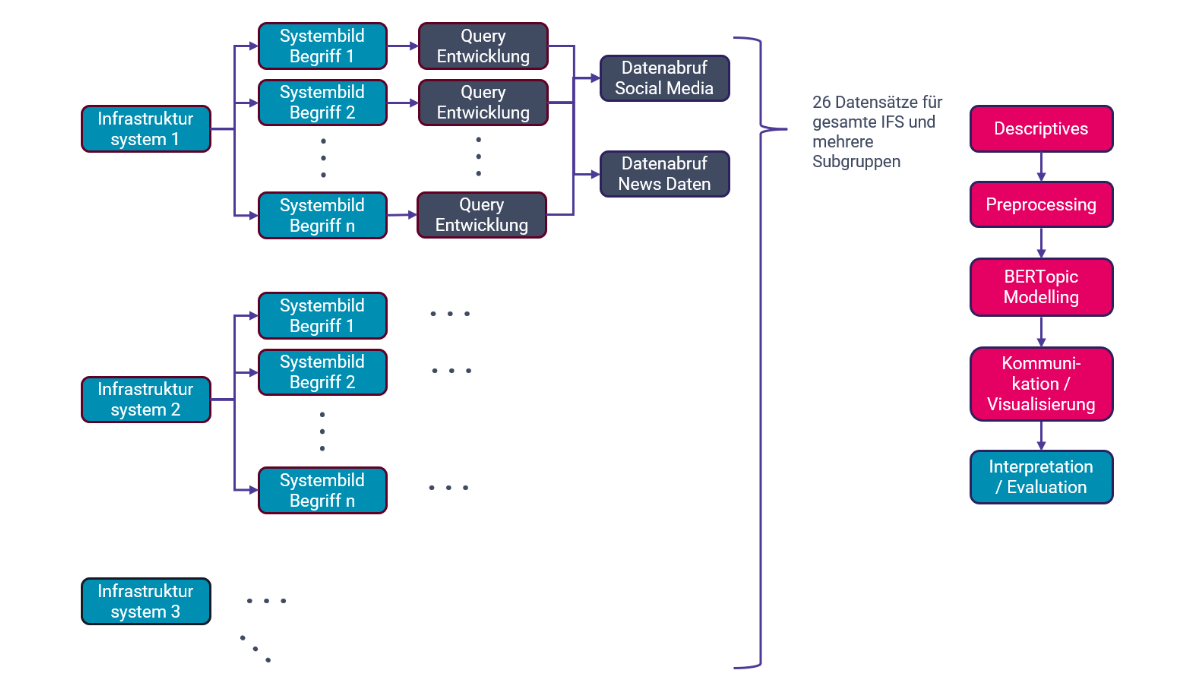

Pilotvorhaben 1: Topic Modeling für Trendanalyse zu Infrastruktursystemen

Mithilfe von digitalen Methoden lassen sich große Datenmengen auswerten und so frühe Anzeichen potenziell bedeutsamer soziotechnologischer Veränderungen identifizieren und gesellschaftliche Einstellungen erfassen (Riousset et al. 2024). In der parlamentarischen TA kommen solche Anwendungen im Rahmen von Foresight-Aktivitäten zum Einsatz (Committee for the Future 2025; POST 2024). Generative KI bietet das Potenzial, durch automatisiertes Screening und Datenextraktion schneller Belege für Trends aufspüren (Tyler et al. 2023) und dabei Daten in ganz unterschiedlichen Sprachen berücksichtigen zu können (Berger-Tal et al. 2024). Im Rahmen der Foresight-Aktivitäten des TAB haben wir in Ergänzung zur qualitativen Analyse von Trends auf der Grundlage ausgewählter Dokumente über 1,2 Millionen Beiträge aus Social Media und Zeitungen mittels der Machine-Learning-Methode des Topic Modeling ausgewertet und die dabei identifizierten Themen wiederum mit Hilfe generativer KI zusammengefasst.

Unsere Erprobungen bestätigen einerseits bekannte Probleme wie Verzerrungen aufgrund einer unausgewogenen Datenbasis und das Auftauchen falscher Ergebnisse, die eine aufwendige Validierung der Ergebnisse erforderlich machen (Sietsma et al. 2024; Parisi/Sutton 2024; Cheng/Zhang 2025; Wilson 2024). Andererseits haben sich die so gewonnenen Hinweise als nützlich erwiesen, um Zwischenergebnisse der manuellen Suche validieren zu können, Lücken aufzudecken und Entwicklungen besser verstehen und in Beziehung zueinander setzen zu können. Weiterentwicklungsbedarf sehen wir bei der Suchstrategie und der Qualität der Datenbasis. Ein weiteres Ziel ist, die Interpretation der gefundenen Themen zu erleichtern und insgesamt den zeitlichen Aufwand zu minimieren. Wir werden diesen mehrstufigen Ansatz in den nächsten Zyklen iterativ verbessern und sind gespannt, wohin diese Reise führt.

Pilotvorhaben 2: Feedback und Qualitätschecks mit KI-Unterstützung

Das zweite Experiment fußt auf der Idee, Feedback von KI-„Kolleg/innen“ zu bekommen, die „in allem geschult“ sind und niemals müde werden (Jones 2025). Im Idealfall befähigen angepasste Chatbots die Forschenden dazu, zusätzliche Perspektiven in ihre Texte zu integrieren (Jones 2025, Naddaf 2025). Allerdings haben die bisherigen Erfahrungen gezeigt, dass die Ergebnisse häufig nicht verlässlich und reproduzierbar sind, sondern von den Trainingsdaten und den zufälligen analytischen Entscheidungen der Modelle abhängen (Jones 2025, Xames 2025, Naddaf 2025, Ye et al. 2024). In unserem Experiment haben wir drei Chatbot-Personas erstellt, die Texte hinsichtlich verschiedener Qualitätskriterien der Politikberatung prüfen sollen: einen wissenschaftlichen Beirat, eine Politikberaterin und ein „Societal Sounding Board“, sprich ein vielfältiges Gremium aus Vertreter/innen der Gesellschaft, das zur Aufgabe hat, Feedback zu Inklusivität, Zugänglichkeit und gesellschaftlicher Resonanz der vorgelegten Texte zu formulieren.

Im Oktober 2025 haben wir die drei Chatbots zusammen mit EPTA Practitioners bei einem Meeting in Bern kritisch unter die Lupe genommen. Durch die Anwendung auf einen EPTA-Report wurden Stärken und Schwächen unserer virtuellen „Kolleg/innen“ sichtbar und kontrovers diskutiert. Die Chatbots überzeugten darin, redundante Abschnitte zu identifizieren sowie solche Aussagen, die eher einem Hype als tatsächlichen Geschehnissen entsprachen. Auch die Hinweise zu Sprache und Formulierungen wurden als hilfreich wahrgenommen, außerdem Hinweise auf mögliche Biases und Verbesserungsmöglichkeiten, die das Leseverständnis erleichtern.

Allerdings stellten sich Hinweise der Chatbots auch als lückenhaft dar und gingen manchmal über das gefragte Maß hinaus, beispielsweise wenn plötzlich politische Empfehlungen einflossen. Die im ersten Abschnitt beschriebene Tendenz, die Nutzenden in ihrer Sichtweise zu bestätigen, führte zudem zu übertriebener Hervorhebung gelungener Inhalte. Unter den EPTA-Kolleg/innen wurde der Einsatz solcher Chatbots daher kontrovers diskutiert. Einige waren der Ansicht, dass Chatbots eher Zeit kosten als einsparen, während andere die zusätzlichen Informationen, die sie liefern, schätzten. Unabhängig davon sahen die Teilnehmenden Potenzial in der Weiterentwicklung besser definierter Eingabeaufforderungen und von Rollen, die die tatsächlichen Arbeitsprozesse in der Politikberatung genauer widerspiegeln. Ein vielversprechender Ansatz könnte außerdem sein, nicht nur einen Chatbot, sondern ein gesamtes Sounding Board verschiedener Bots Feedback geben zu lassen – in der Hoffnung, so etwas mehr Einblick in die Argumentation und Kontrolle über die Gewichtung der Perspektiven zu erlangen und damit den Nutzen der Chatbots zu verbessern. Auch dieses Experiment ruft also nach einer Wiederholung.

Veränderungen der Arbeitspraxis durch generative KI werden reflektiert

Neben der Reflexion über die konkreten Chancen und Herausforderungen stellt sich auch die Frage, wie sich Wissensgenerierungsprozesse in der TA durch den Einsatz von GenKI verändern. Daher führen die ebenfalls an der Arbeitsgruppe beteiligten ITAS-Kolleg/innen Kurzinterviews mit TAB-Mitarbeiter/innen durch, um punktuell zu erkunden, welche Tools in welchen Kontexten angewendet werden, wie damit experimentiert wird und wie sich Wissensproduktion verändert. Die ersten vier Interviews ergeben eine Art Momentaufnahme, die sich folgendermaßen zusammenfassen lässt: Übergreifend zeigt sich, dass es die Einschätzung einer gewissen Beschleunigung der Wissensproduktion gibt, wobei vieles noch in “Erprobungsphasen” ist. Hinzu kommt die Wahrnehmung der Produktion von mehr Textmaterial durch generative KI, was wiederum die Verwendung dieser Tools notwendig macht. Hier zeigt sich ein gewisses Spannungsfeld zwischen Effizienzgewinn durch die Tools und die damit einhergehende potenzielle Abhängigkeit. Darüber hinaus zeigt sich eine mögliche Verschiebung in der Verwendung. Der bisherige Fokus auf das Verfassen von Texten mit Hilfe generativer KI könnte sich verändern: Datenauswahl und -pflege ebenso wie Qualitätskontrolle rücken stärker in den Vordergrund. Es zeigt sich, dass eine solche Begleitung und Reflexion der Arbeit mit generativer KI enorm wichtig ist, um Mehrwerte und Chancen für die parlamentarische TA zu erkennen sowie kontinuierlich die Grenzen der KI-Nutzung im Blick zu behalten.

Unsere neue Arbeitsrealität - ein Zwischenfazit

In der neuen Realität der KI-unterstützten parlamentarischen TA geht Studieren nur über den Weg des Probierens. In einigen Bereichen liefert die Nutzung generativer KI Ergebnisse, die zu ihrer weiteren Nutzung ermutigen. Mit ihrer Hilfe lassen sich größere Datenmengen verarbeiten, wie bei den Recherchen zu den Foresight-Reports des TAB. Hier werden die kommenden Analysen dank generativer KI und anderen Techniken des maschinellen Lernens ergänzend stärker quantitativ gestützt. Generative KI kann außerdem als Sparringspartner bei der Erstellung der TAB-Berichte dienen und die angestrebte Vielfalt der Perspektiven erweitern. Als wichtig hat sich dabei eine enge Anbindung an die individuellen Arbeitsprozesse erwiesen. Zum einen, weil die Art der KI-Nutzung stark von subjektiven Vorgehensweisen und Vorlieben abhängt, zum anderen, um die menschliche Kontrolle über die Ergebnisse zu behalten. Eine solche Kontrolle ist immer nötig und erfordert neben fachlichen Kompetenzen gemäß unseren Erfahrungen auch viel Zeit. Bisher ergibt sich durch die Nutzung von KI für komplexere Anwendungen daher in der Summe keine wesentliche Zeitersparnis. Bei kleineren, repetitiven Aufgaben, wie KI-Übersetzungen oder Bildbeschreibungen (die wir auch für diesen Beitrag eingesetzt haben), ist dies aber durchaus der Fall. Gleiches gilt, wenn generative KI für Zwischenschritte in umfassenderen Untersuchungen wie der Trendanalyse eingebunden wird. Um angesichts der Vielfalt von Anwendungsmöglichkeiten und in Aussicht gestellter Erleichterungen diejenigen Fälle zu identifizieren, in denen die KI-Nutzung Vorteile bringt, sind weitere Experimente nötig. Ebenso nötig ist deren reflexive Begleitung, um auch solche Nebenwirkungen in den Blick zu bekommen, die möglicherweise nicht offensichtlich sind, aber den Zielen der parlamentarischen TA entgegenstehen.

Wir möchten die Arbeit mit generativer KI im Austausch weiterdenken. Teilen Sie gern Ihre Erfahrungen oder Fragen mit uns – sie bereichern den Diskurs und fließen in die nächsten Beiträge der Reihe „KI und parlamentarische TA“ ein.

Kontakt: info∂tab-beim-bundestag.de

Updates aus unseren Projekten und Beobachtungen und Analysen zu gesellschaftlich relevanten Themen des wissenschaftlich-technischen Wandels

Entdecken